Разработана система искусственного интеллекта, реконструирующая изображения, которые видел человек, на основе активности его мозга. О разработке сообщает «Хайтек» со ссылкой на Science.

Нейробиологи до сих пор до конца не понимают весь процесс того, как мозг преобразует визуальную информацию в мысли. Но это не мешает ИИ имитировать этот процесс. Японские ученые объединили алгоритмы, преобразующие текст в изображение, и систему анализа мозговой активности. ИИ Stable Diffusion сканирует мозг человека и воссоздает относительно реалистичные версии изображений, которые он видел.

Оригинальные изображения (сверху) и снимки, полученные в результате распознавания мозговой активности Stable Diffusion. Изображение: Yu Takagi, Shinji Nishimoto, bioRxiv

Это не первое исследование, в котором ученые использовали ИИ для чтения снимков мозга и воссоздания изображений. Но в новой работе они добавили дополнительный этап: при обучении ИИ используются текстовые описания фотографий. В результате алгоритм анализирует не только мозговую активность, связанную с просмотром изображений, но и текстовое описание. Это напоминает работу популярных алгоритмов, таких как DALL-E 2 и Midjourney.

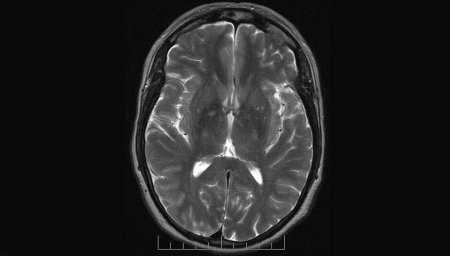

Для распознавания образов Stable Diffusion использует данные сканирования мозга с помощью функциональной магнитно-резонансной томографии (фМРТ), собранные при просмотре различных изображений. Когда люди смотрят на фотографию, височные доли анализируют информацию о содержании изображения (людях, объектах или декорациях), а затылочные — о расположении и перспективе, такую как масштаб и положение содержимого.

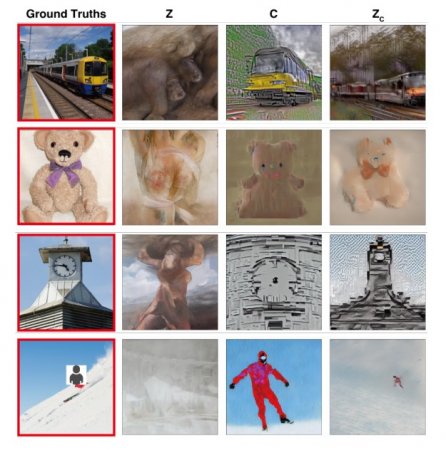

Для обучения ИИ исследователи использовали набор картинок и паттерны мозговой активности, собранные при их просмотре. При простом обучении алгоритм эффективно воссоздавал расположение объектов и перспективу просматриваемых фотографий, но вместо реальных объектов в центре композиции рисовал абстрактные фигуры. Но, после того как ученые добавили текстовые описания к фотографиям, использованным при обучении, качество сгенерированных образов существенно возросло.

Оригинальное изображение (слева) и образы, полученные при использовании алгоритмов, обученных на визуальных (z), текстовых (c) и комбинированных данных (справа). Изображение: Yu Takagi, Shinji Nishimoto, bioRxiv

Исследователи отмечают, что комбинация текстовых и визуальных данных при обучении позволяет существенно сократить объем данных, которые необходимо использовать для обучения модели. В то же время они отмечают, что пока ИИ был обучен и протестирован только на данных фМРТ для четырех человек. Вероятно, потребуется выборка от большого количества людей для создания универсального алгоритма.